현행법상 불법 촬영물이 온라인에 유포됐을 때 당사자와 보호자·대리인만 삭제를 요청할 수 없다. 해당 범죄의 특성상 초기에 접근 차단과 삭제 조치가 이뤄지지 않으면 피해를 막기 어려워 법안 개정이 필요하다는 목소리가 커지고 있다.

교육부가 공개한 ‘학교 딥페이크 허위 영상물 피해 현황’을 보면 지난 1월부터 8월까지 딥페이크 피해 학생은 908명, 피해 교원 36명으로 집계됐다. 딥페이크 피해 건수도 561건으로 나타났다.

딥페이크 사진이나 영상은 인공지능(AI) 얼굴 합성 홈페이지와 애플리케이션을 이용해 누구나 쉽게 만들 수 있다. 딥페이크 제작은 10여초 남짓으로 합성하고 싶은 이미지와 합성 대상의 사진만 있으면 가능하다.

또 딥페이크 사진·영상물 확산 속도는 걷잡을 수 없이 빠르다. 메신저와 SNS를 통해 불특정 다수에게 딥페이크 사진·영상물이 퍼지면 이 내용이 다시 공유된다. 해당 내용을 막기는 불가능에 가깝다.

이 때문에 딥페이크 사진·영상물 피해를 막기 위해서는 빠른 차단이 중요하다. 확산이 시작되는 시점에 해당 자료를 삭제하거나 접근할 수 없게 해야 한다.

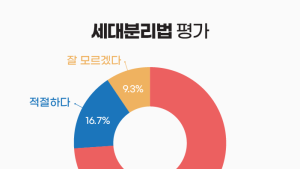

현행법은 사이버폭력 촬영물이 온라인에 유통돼 학생이 피해를 보면, 당사자와 보호자·대리인이 국가에 삭제 지원을 요청할 수 있게 했다. 그러나 해당 방식이 피해를 조기 대응하기에 부족하다는 지적이 나오고 있다.

이에 백승아 더불어민주당 의원은 ‘학교폭력예방 및 대책에 관한 법률 일부개정법률안’을 발의했다. 이 법안이 통과되면 교육감이나 교육장이 피해 학생과 보호자의 동의 없이 국가에 촬영물 삭제를 요청할 수 있게 된다.

법안의 세부사항을 살펴보면 제16조의4 제3항을 신설해 ‘교육감·교육장은 신속한 보호조치가 필요하다 판단한 경우 대통령령으로 정하는 바에 따라 국가에 촬영물 삭제 지원을 요청할 수 있다’는 내용을 포함했다.

백 의원은 15일 쿠키뉴스와 통화에서 “디지털 성범죄 특성상 미성년 피해자는 자책하고 숨는 경우가 많다”며 “피해자가 숨으면 더 큰 위험에 빠지게 된다”고 우려했다.

아울러 “해당 법안이 통과되면 교육감·교육장이 피해 학생 요청 없이도 삭제 지원을 요청할 수 있고 사이버폭력 피해 대응이 신속하게 이뤄질 것”이라며 “궁극적으로 피해 학생의 학업·사회 복귀 지원에도 크게 기여할 수 있다”고 강조했다

.